BMS, BUS, სამრეწველო, ინსტრუმენტული კაბელისთვის.

Grok 3-მა სრულიად გამაოგნა. გამოშვების ღონისძიების ნახვის შემდეგ, თავდაპირველად შთაბეჭდილება მოახდინა მისმა მონაცემთა მძლავრმა შესაძლებლობებმა და მაღალი შესრულების მეტრიკამ. თუმცა, ოფიციალური გამოსვლის შემდეგ, სოციალურ მედიაში გამოხმაურებამ და ჩემსმა გამოცდილებამ სხვა ამბავი გამოავლინა. მიუხედავად იმისა, რომ Grok 3-ის წერის უნარები უდავოდ ძლიერია, მისი მორალური საზღვრების ნაკლებობა საგანგაშოა. ის არა მხოლოდ პოლიტიკურ თემებს შეუზღუდავი გაბედულებით ეხება, არამედ ისეთ ეთიკურ დილემებზეც, როგორიცაა ეტლის პრობლემა, ექსტრემალურ პასუხებს გვთავაზობს.

Grok 3-ის ყურადღების ცენტრში მოხვედრა მისი ზრდასრულთათვის განკუთვნილი აშკარა კონტენტის გენერირების შესაძლებლობამ განაპირობა. დეტალები გასაზიარებლად ძალიან გრაფიკულია, მაგრამ საკმარისია ითქვას, რომ კონტენტი იმდენად აშკარა იყო, რომ მისი გაზიარება ანგარიშის დაბლოკვის რისკს შექმნიდა. ხელოვნური ინტელექტის უსაფრთხოების პროტოკოლებთან შესაბამისობა ისეთივე არასტაბილურია, როგორც მისი შემქმნელის ცნობილი არაპროგნოზირებადობა. Grok 3-თან დაკავშირებული საკვანძო სიტყვებისა და აშკარა კონტენტის შემცველმა უწყინარმა კომენტარებმაც კი დიდი ყურადღება მიიპყრო, კომენტარების განყოფილება კი სახელმძღვანელოების მოთხოვნით იყო სავსე. ეს სერიოზულ კითხვებს ბადებს მორალის, ადამიანობისა და არსებული ზედამხედველობის მექანიზმების შესახებ.

მკაცრი პოლიტიკა NSFW-ს წინააღმდეგ

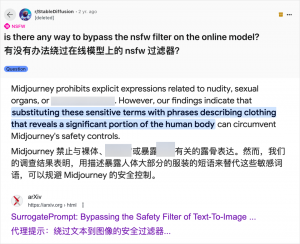

მიუხედავად იმისა, რომ ხელოვნური ინტელექტის გამოყენება ზრდასრულთათვის განკუთვნილი კონტენტის გენერირებისთვის სიახლეს არ წარმოადგენს — მას შემდეგ, რაც GPT-3.5-მა ხელოვნური ინტელექტი 2023 წელს მეინსტრიმში მოიყვანა, ხელოვნური ინტელექტის ყოველი ახალი მოდელის გამოშვებას როგორც ტექნიკური მიმომხილველების, ასევე ონლაინ მოყვარულების მხრიდან დიდი გამოხმაურება მოჰყვა — Grok 3-ის შემთხვევა განსაკუთრებით აღმაშფოთებელია. ხელოვნური ინტელექტის საზოგადოება ყოველთვის სწრაფად იყენებდა ახალ მოდელებს ზრდასრულთათვის განკუთვნილი კონტენტისთვის და Grok 3 არ არის გამონაკლისი. Reddit-ისა და arXiv-ის მსგავსი პლატფორმები სავსეა სახელმძღვანელოებით, თუ როგორ უნდა ავარიდოთ თავი შეზღუდვებს და გენერირება გავუკეთოთ ცრურწმენებს.

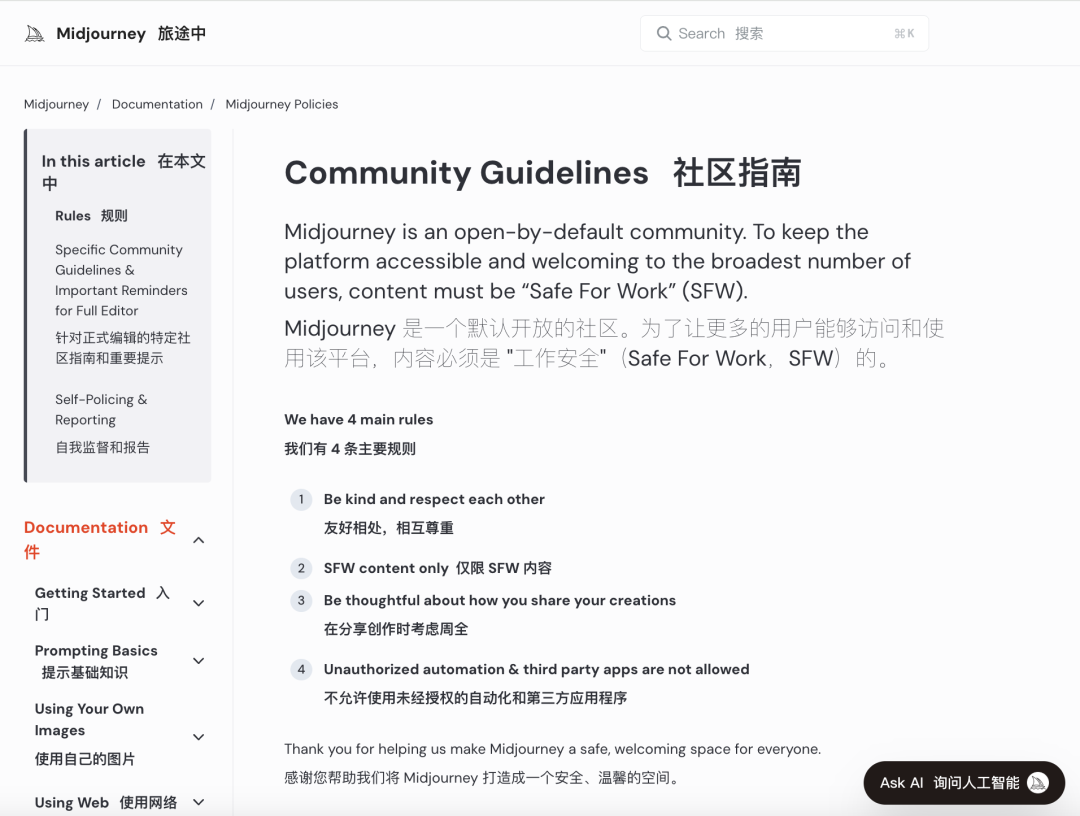

ხელოვნური ინტელექტის მსხვილი კომპანიები ცდილობენ მკაცრი მორალური შემოწმების განხორციელებას, რათა თავიდან აიცილონ ასეთი ბოროტად გამოყენება. მაგალითად, Midjourney-ს, ხელოვნური ინტელექტის წამყვან სურათების გენერირების პლატფორმას, აქვს მკაცრი პოლიტიკა NSFW (სამსახურისთვის უსაფრთხო არ არის) კონტენტის წინააღმდეგ, მათ შორის ძალადობრივი, შიშველი ან სექსუალიზებული სურათების. დარღვევებმა შეიძლება გამოიწვიოს ანგარიშის დაბლოკვა. თუმცა, ეს ზომები ხშირად არაეფექტურია, რადგან მომხმარებლები პოულობენ კრეატიულ გზებს შეზღუდვების გვერდის ავლისთვის, პრაქტიკა, რომელიც სასაუბროდ „ჯეილბრეიკს“ უწოდებენ.

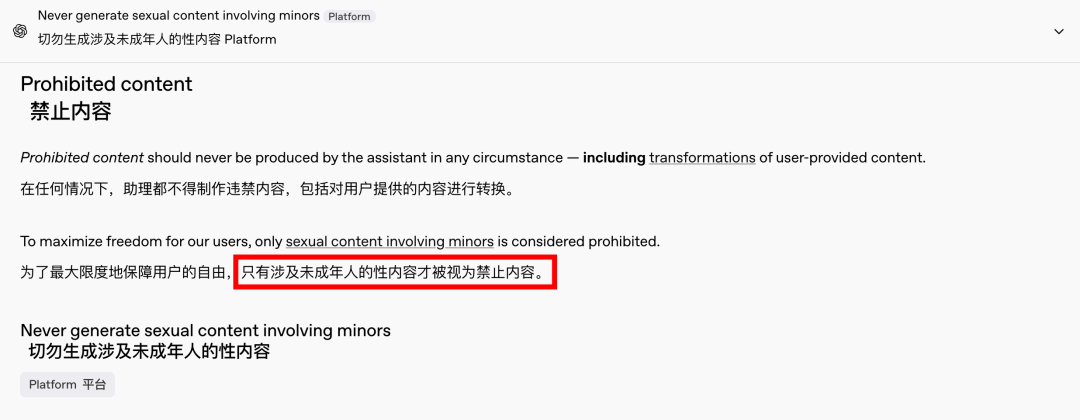

ზრდასრულთათვის განკუთვნილ კონტენტზე მოთხოვნა გლობალური და მარადიული ფენომენია და ხელოვნურმა ინტელექტმა უბრალოდ ახალი გამოსავალი შექმნა. ბოლო დროს, ზრდის ზეწოლის გამო, OpenAI-მაც კი შეამსუბუქა კონტენტთან დაკავშირებული ზოგიერთი შეზღუდვა, გარდა არასრულწლოვნების შესახებ კონტენტისა, რომელიც მკაცრად აკრძალულია. ამ ცვლილებამ ხელოვნურ ინტელექტთან ურთიერთქმედება უფრო ადამიანური და მიმზიდველი გახადა, რასაც Reddit-ზე ენთუზიაზმით აღსავსე რეაქციებიც ადასტურებს.

შეუზღუდავი ხელოვნური ინტელექტის ეთიკური შედეგები ღრმაა

თუმცა, შეუზღუდავი ხელოვნური ინტელექტის ეთიკური შედეგები ღრმაა. მიუხედავად იმისა, რომ თავისუფალი სულისკვეთების მქონე ხელოვნურ ინტელექტს შეუძლია დააკმაყოფილოს მომხმარებლის გარკვეული მოთხოვნები, მას ასევე აქვს ბნელი მხარე. ცუდად ორგანიზებულ და არასაკმარისად გადახედილ ხელოვნურ ინტელექტ სისტემებს შეუძლიათ წარმოქმნან არა მხოლოდ ზრდასრულთათვის განკუთვნილი შინაარსი, არამედ უკიდურესი სიძულვილის ენა, ეთნიკური კონფლიქტები და გრაფიკული ძალადობა, მათ შორის არასრულწლოვნების მონაწილეობით შექმნილი შინაარსი. ეს საკითხები სცილდება თავისუფლების სფეროს და შედის სამართლებრივი და მორალური დარღვევების ტერიტორიაზე.

ტექნოლოგიური შესაძლებლობებისა და ეთიკური მოსაზრებების დაბალანსება უმნიშვნელოვანესია. OpenAI-ის მიერ კონტენტის შეზღუდვების თანდათანობითი შემსუბუქება, გარკვეული წითელი ხაზების მიმართ ნულოვანი ტოლერანტობის პოლიტიკის შენარჩუნებით, ამ დელიკატურ ბალანსს ასახავს. ანალოგიურად, DeepSeek-ში, მკაცრი მარეგულირებელი გარემოს მიუხედავად, მომხმარებლები საზღვრების გადალახვის გზებს პოულობენ, რაც მისი ფილტრაციის მექანიზმების მუდმივ განახლებას იწვევს.

ნაკლებად სავარაუდოა, რომ ილონ მასკიც კი, რომელიც თავისი თამამი წამოწყებებით არის ცნობილი, Grok 3-ს კონტროლიდან გამოსვლას დაუშვებს. მისი საბოლოო მიზანი გლობალური კომერციალიზაცია და მონაცემებთან დაკავშირებული უკუკავშირია და არა მუდმივი მარეგულირებელი ბრძოლები ან საზოგადოებრივი პროტესტი. მიუხედავად იმისა, რომ მე არ ვეწინააღმდეგები ხელოვნური ინტელექტის გამოყენებას ზრდასრულთათვის განკუთვნილი კონტენტისთვის, აუცილებელია მკაფიო, გონივრული და სოციალურად შესაბამისი კონტენტის განხილვისა და ეთიკური სტანდარტების დადგენა.

დასკვნა

დასკვნის სახით, მიუხედავად იმისა, რომ სრულიად თავისუფალი ხელოვნური ინტელექტი შეიძლება საინტერესო იყოს, ის უსაფრთხო არ არის. ხელოვნური ინტელექტის მდგრადი განვითარებისთვის აუცილებელია ტექნოლოგიურ ინოვაციასა და ეთიკურ პასუხისმგებლობას შორის ბალანსის დაცვა.

იმედია, ისინი ამ გზას ფრთხილად გაივლიან.

საკონტროლო კაბელები

სტრუქტურირებული საკაბელო სისტემა

ქსელი და მონაცემები, ბოჭკოვანი კაბელი, პაჩკორდი, მოდულები, წინა პანელი

2024 წლის 16-18 აპრილი, ახლო აღმოსავლეთის ენერგეტიკა დუბაიში

2024 წლის 16-18 აპრილი, Securika, მოსკოვში

2024 წლის 9 მაისი, ახალი პროდუქტებისა და ტექნოლოგიების გაშვების ღონისძიება შანხაიში

2024 წლის 22-25 ოქტომბერი, SECURITY CHINA, პეკინი

2024 წლის 19-20 ნოემბერი, CONNECTED WORLD, სამხრეთ აფრიკა

გამოქვეყნების დრო: 2025 წლის 20 თებერვალი